Выбор и оценка LLM

Итак: вы сели писать LLM-powered сервис. Скачали зависимости, создали .py файл, импортировали ваш фреймворк. Перед вами вопрос - какую model_name выбрать?

Questions

- Какая модель сейчас топ-1 под мой юзкейс?

- Как разные модели сравниваются друг с другом?

- Что для бизнеса важно кроме точности ответов?

- Как быть эмпирически уверенным в выборе модели?

Steps

1. tl;dr;

Самый простой вариант - идем на artificalanalysis.ai/models и выбираем что-то самое лучшее. Это онлайн-обновляемый непредвзятый рейтинг LLM.

Рейтинги моделей по кейсам на этом сайте - это просто агрегация результатов на разных бэнчмарках.

2. Все способы оценки LLM.

Let's read cool guide by Confident AI Cofounder Jeffrey Ip:

- Или перевод от создателя llmarena.ru и просто крутого мужика Ромы Куцева - habr!

3. Популярные бэнчмарки

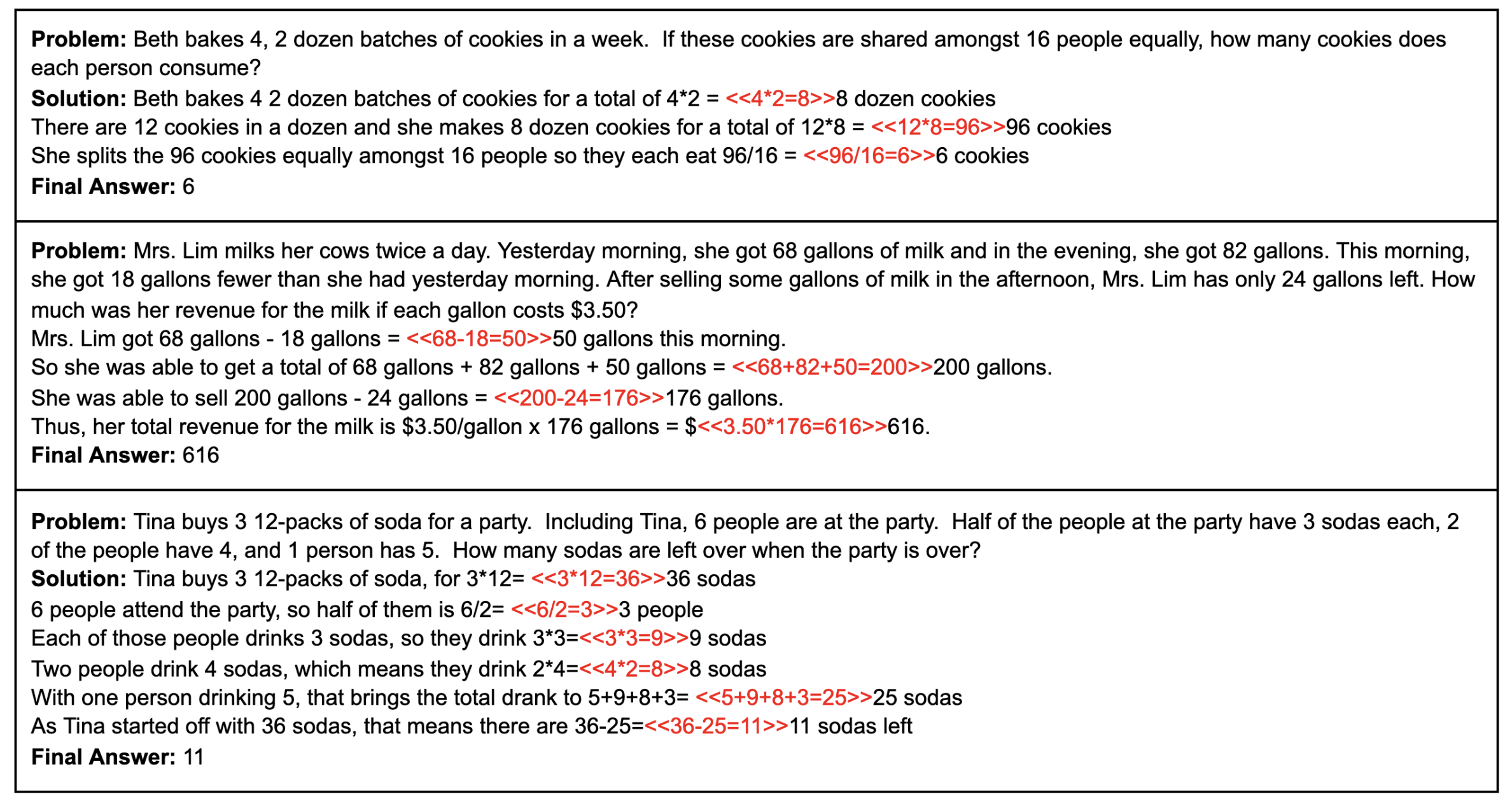

Бэнчмарк - это способ оценки модели. Например, мы можем дать на вход модели инструкцию решить математическую задачу и ее описание. Дать 100 таких задач и сравнивать модели по количеству правильных ответов.

Вот как выглядят задачки из популярного бэнчмарка GSM8K:

7 Popular LLM Benchmarks Explained [OpenLLM Leaderboard & Chatbot Arena]

Исследование бэнчмарков

- Категории бэнчмарков

- Популярные бэнчи в деталях

- Ключевые метрики оценки

- Ограничения оценки LLM бэнчмарками

- Будущее бэнчмарков

LLM Tool Use Benchmarks

4. Как бизнес выбирает модель для продакшена?

В проде в принципе всё очень просто выбирается:

- Онлайн-исследования, например смотрят на то что юзают коллеги и на artificalanalysis.ai/models

- есть оффлайн и онлайн метрики. Сначала делают замеры на оффлайн-сформированных бэнчмарках. Далее для дополнительной уверенности можно выкатить несколько моделек в прод на разные подгруппы юзеров (АБ-тест) и замерить там уже онлайн метрики. Весь этот процесс - валидация пайплайна.

- кроме качества работы нас еще могут интересовать дохера параметров - $ per tokens, tokens per second (TPS), конфиденциальность (в чьем контуре работает модель = куда мы носим данные), функциональность экосистемы (возможность легко дообучать модель под свои нужды, serverless фичи (как Internet-search, треды в OpenAI Assistants))

- частно придуманные моменты, которые могут сформироваться у конкретного кейса (например, политика ответов на конкретные 10 супер важных для клиента вопросов (ака "что произошло в китае в таком-то году")

Ну и тут как при покупке ноутбука или машины, ты пытаешься найти оптимум с учетом кучи разных параметров.

Для бизнеса самые важные параметры (выше = важнее):

- Легальность и конфиденциальность (License, свой контур или соответствие ФЗ-152/GDPR/SOC)

- Минимально удовлетворимое качество

- Цена или экосистема

- Экосистема или цена

- Максимальное качество (да, максимальное качество модели не так важно, как, например, возможность дообучать модели под свои задачи)

Понятное дело это не всё, но в целом самое важное. Также могут учитывать: Количество фич при работе с моделью (можно ли динамически управлять температурой?), DevX, этичность и безопасность LLM (или наоборот), для локального инференса - запускается ли модель на наших GPU.

Под качеством подразумевается:

- качество модели на конкретном кейсе или кейсах

- глобальный кругозор модели и качество на других задачах - так как в проде пользователь может делать с LLM что угодно

- скорость инференса (TPS) или end-to-end response time (высокий у reasoning-моделей)

- Time to first token (TTFT)

- модальности модели (Работа с картинками, графиками, голосом, аудио, видео, 3D, и т.д. на вход и на выход)

Прочие метрики:

- Perplexity - насколько хорошо модель предсказывает заданный текстовый фрагмент

- Умение писать "человечный" текст с низкой переплексией :)

- различные biases модели (например, в ответах на вопросы о политике или расовой принадлежности)

- плавность (fluency), когерентность (coherence) и релевантность содержанию (subject relevance)

- этичность и безопасность (включая токсичность)

Еще я бы добавил метрику sustainability - насколько модель устойчива к следованию инструкциям в зависимости от того, насколько далеко мы отходим от наших бэнчмарков. Например, мы выбираем между двумя моделями Х и У с точностями на нашем бэнчамрке 94 и 95. Вроде бы должны выбрать вторую. Но как только мы начинаем отходить от кейсов нашего бэнчмарка немного в сторону в плане инструкций, контекста и тд, то первая модель продолжает работать хорошо - а вторая вообще перестает работать.

И всё это как в статике - так и в динамике - то есть с учетом скорости развития LLM-вендоров

Если в компании есть NLP-инженеры - то этой задачей будут заниматься они.

5. Как быть эмпирически уверенным в выборе модели?

Сколько на исследования и бэнчмарки в интернете не смотри - для продакшена мы хотим иметь собственные денные оценки LLM.

- или набор примеров input-correct output + оценщики (Люди-ассессоры или LLM)

- или среду с автоматической оценкой (например, компилируется ли код)

Как сделать свой бэнчмарк - обсудим в конце блока Junior. В блоке Senior мы будем говорить про оценку workflow и агентов.

Extra Steps

E1. Вообще я рекомендую почитать вам и другие статьи Ромы про eval - он написал замечательную серию:

- Оценка систем LLM: основные метрики, бенчмарки и лучшие практики

- Оценка чат-ботов LLM: основные метрики и методы тестирования

- Оценка систем больших языковых моделей (LLM): метрики, проблемы и лучшие практики

- Бенчмаркинг AI-агентов: оценка производительности в реальных задачах

- Оценка больших языковых моделей в 2025 году: пять методов

Подробнее про eval систем и агентов будет в блоках Junior, Sinior, Research.

RU переводы:

- Оценка систем LLM: основные метрики, бенчмарки и лучшие практики

- Оценка чат-ботов LLM: основные метрики и методы тестирования

- Оценка систем больших языковых моделей (LLM): метрики, проблемы и лучшие практики

- Бенчмаркинг AI-агентов: оценка производительности в реальных задачах

- Оценка больших языковых моделей в 2025 году: пять методов

Now we know...

Мы изучили подходы к выбору и оценке языковых моделей для разработки AI Агентов, включая использование рейтинговых сервисов, понимание бенчмарков и ключевых бизнес-факторов. Разобрались, что включает в себя понятие "качества" модели и почему важна собственная оценка для продакшена. Эти знания позволяют делать обоснованный выбор LLM для конкретных задач.

Exercises

Вопросы для размышления

-

Вы делаете ассистента:

- для медицинской консультации

- для поиска информации (с чтением большого количества документов)

- для клиентской поддержки

- голосового робота для клиентской поддержки

- для написания творческого текста

- для написания кода

- для написания текста диплома (с целью иметь низкую вероятность деткеции того, что это GPT-сгенерированный текст)

- для работы в закрытом контуре вашей компании

- для государственного учреждения с низкими репутационными рисками при использовании в проде

- агента, который пользуется большим количеством инструментов

1. Внимательно подумайте, по каким критериям вы бы выбирали LLM для каждого из этих случаев.

2. Подумайте, на какие бэнчмарки вы бы обращали внимание

3. Подумайте, какие бы метрики вы бы использовали для оценки LLM в проде? Например, для АБ-теста

-

Проанализируйте преимущества и недостатки использования других LLM в качестве оценщиков (evaluators) для ваших моделей. В каких случаях это может быть оправдано?

-

Подумайте о том, почему даже использование ассессеров (людей) может приводить к ошибкам в оценке LLM.

-

Почему максимальное качество модели часто не является самым важным фактором для бизнеса?

Практическое задание

- Зарегистрируйтесь на cloud.agenta.ai

- Создайте completion-задачу, справа сверху в "Load test set" загрузите вопросы из completion_testset и попробуйте какую-нибудь LLM.

- Теперь попробуйте создать свой бэнчмарк под какую-нибудь задачу посложнее и сравните несколько моделей.

Изучите, какой еще функционал есть в cloud.agenta.ai.

https://youtu.be/lX1oLcgkZXg?si=CTEch5uGImDq0aOj - еще один способ оценивать LLM, используя GPT-eval. Не погружайтесь сейчас конкретно в этт LLMOps инструмент - в будущем мы будем вместе выбирать их в модулях про AgentOps.